Основные этапы технического аудита сайта с Netpeak Spider

Привет! Сегодня хочу рассказать об основных этапах технического аудита сайта с помощью Netpeak Spider, на что обратить внимание в первую очередь, каких косяков нельзя допускать ни в коем случае и что делать, если проблемы на сайте всё же обнаружились?

Содержание статьи:

Главные враги внутренней оптимизации сайта

Когда мне заказывают аудит сайта, я делю его на три части:

- Техническая.

- Контентная.

- Ссылочная.

В рамках данной статьи обсудим первый пункт – технический аудит сайта.

При анализе сайта с целью выявления проблем следует обратить внимание на:

- Скорость загрузки сайта;

- Правильно настроенные редиректы;

- Грамотный txt;

- Мусор в поисковой выдаче;

- Дубли страниц;

- Битые ссылки и 404 ошибки;

- Мета-теги и дублированные мета-теги.

Это основные моменты, которые нельзя оставлять без внимания.

Раньше я все перечисленные ошибки искал вручную, проходя по чек-листу шаг за шагом, но теперь это делаю с помощью программы Netpeak Spider. Подробнее обо всех её функциях я писал раньше, можете ознакомиться, сегодня просто вкратце расскажу как провести экспресс-аудит технической составляющей сайта.

Технический аудит с помощью Netpeak Spider

Итак, для того чтобы выявить проблемы на сайте достаточно запустить «Паука», вбить домен и подождать 5-7 минут.

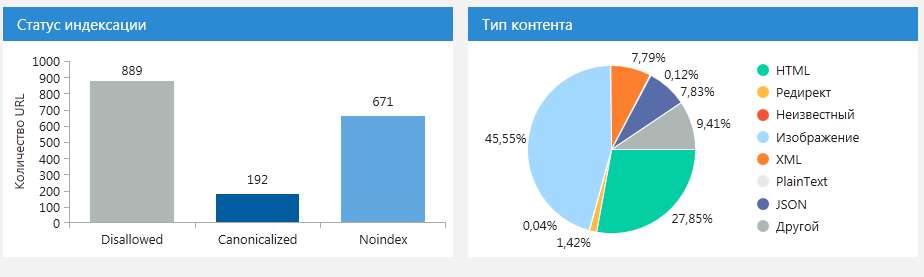

После этого Netpeak Spider выдаст подробную информацию по сайту:

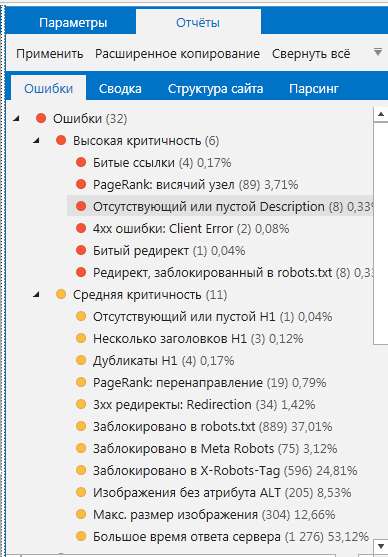

В правой части отображаются найденные проблемы:

Очень удобно, что по клику по какому-либо из косяков вы сразу перемещаешься к списку урлов, где обнаружена та или иная проблема:

Например, у себя в блоге я нашёл несколько не приятных и даже критичных ошибок:

- Несколько битых ссылок.

- Обнаружился «висячий узел». Хотя конкретно с этой ошибкой я не согласен, т.к. там есть ряд статей, которые намеренно накачиваются весом и соответственно не отдают его другим статьям. Кроме того, в «висячий узел» попали, например, страницы пагинации.

- В нескольких статьях (а точнее у рубрик) не были прописаны Description.

Также немало ошибок средней критичности:

- Умудрился поставить в одной статье два Н1.

- Нашёл несколько ссылок, которые вели на удалённые мною статьи внутри блога.

- Несколько дублей Н1 из-за недавно созданного разедела Вопросы-Ответы, который был создан с помощью плагина. Кстати, у кого есть вопросы ко мне – задавайте, с радостью отвечу )).

- По какой-то не понятной причине Spider ругается на редиректы и закрытые в robots.txt не нужные, по моему мнению страницы. Прога от Нетпика считает это ошибками.

- С картинками тоже беда оказалась, в части из них не прописаны Alt, а часть слишком громоздкая. Однако, на самом деле Паук нашёл картинки на серваке, но выводятся другие, меньшего размера.

- Долгий ответ сервера. Это беда блога. Я уже многократно писал, что блог вообще ради эксперимента затевался, а потом это переросло в то, во что перерасло, но сменить тему и оптимизировать код сайта всё недоходят руки…

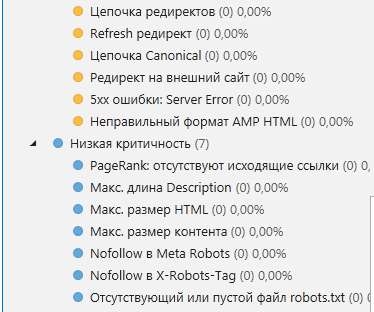

Это из основных, а так ещё по мелочи довольно большое количество недочётов, таких как:

- Часть мета-тегов слишком короткие.

- Есть дубли в канонических урлах. Но опять-таки, не понимаю почему он считает это ошибкой, т.к. например, все найденные дубли относятся к АМР-страницам.

- Одинаковые Н1 и Title. Признаюсь, раньше грешил этим из-за банальной лени…))

- Превышение допустимого лимита внутренних ссылок (круче Википедии умудрился на линковать )) ).

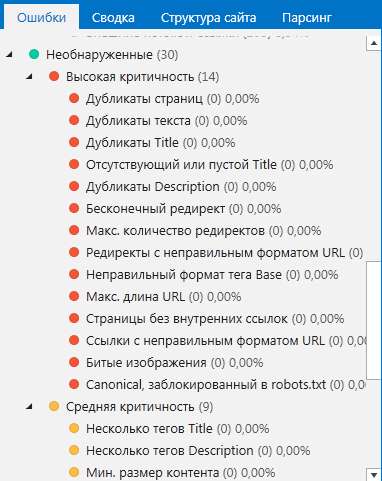

Это то что нашёл Netpeak Spider у меня в блоге, но на самом деле он проверяет гораздо больше всего, вот, например, что обошло меня стороной:

Внушительный список, не правда ли? И что самое главное, всё это Spider нашёл буквально за 5 минут! Если бы я всё это анализировал вручную, мне бы потребовалось потратить несколько дней.

Стоит отметить, что можно начать правки как переходя на проблемные страницы непосредственно из программы, так и выгрузив необходимые части отчёты в Excel. Это очень удобно при условии, что не планируется вносить правки сразу после завершения технического аудита или если эти задачи будут делегированы сотрудникам (про делегирование я раньше писал несколько статей №1 и №2, а также про то как я начинал делегировать и меня душила жаба), берёшь нужный файлик и отправляешь его сеошнику или программисту.

Вывод

Если хотите за считанные минуты проверить сайт на ошибки внутренней технической оптимизации, то вариант с продуктом от Netpeak Software под названием Spider – это то, что нужно. Кстати, перейдя по этой ссылке вы получите 10% скидку на программу, ну или можете просто ввести этот промокод – feb23bd6.

Быстро и довольно качественно (хотя и не без определённых моментов, с которыми я не согласен) «паук» пробегает по сайту и предоставляет исчерпывающую информацию о проблемах на анализируемом сайте, а с помощью удобного интерфейса можно легко пробежаться по выданным спискам косячных урлов и поправить ошибки налету.